Mô Hình Tổng Quát Đang Thất Bại Ở Ngưỡng Cửa Lớp Học

Suốt một thập kỷ, chúng ta bị dẫn dắt bởi niềm tin càng lớn càng tốt. Những mô hình cloud khổng lồ được kỳ vọng sẽ tái định nghĩa giáo dục. Nhưng trong lớp học thực tế, bức tranh khác hẳn: độ trễ cao, sai lệch ngữ cảnh địa phương, và đầu ra nghe rất tự tin nhưng đầy rác tri thức.

Với học sinh năm 2026, độ trễ cloud là kẻ giết chết trạng thái flow. Với nhà trường, cloud là bãi mìn pháp lý. Tương lai của giáo dục cá nhân hóa đang dịch về edge, nơi các mô hình ngôn ngữ nhỏ (SLM) chạy trực tiếp trên thiết bị học sinh.

Ở đây, hiệu suất chứ không phải số tham số mới là thước đo đáng tin của trí tuệ ứng dụng.

Giải Mã: Vì Sao Mô Hình Nhỏ Có Thể Vượt Mô Hình Lớn

Mô hình lớn không chỉ mang thêm năng lực, mà còn mang theo nhiễu.

Các hệ tổng quát được huấn luyện để nhớ mọi thứ, kể cả phần không liên quan đến một học sinh lớp 10 đang học hóa. Kết quả là độ trễ tăng, tín hiệu sư phạm giảm.

Bước ngoặt kỹ thuật đến từ lượng tử hóa (quantization): nén trọng số từ độ chính xác cao xuống dạng gọn như INT4 nhưng vẫn giữ cấu trúc cốt lõi qua hàm tỉ lệ.

Ẩn dụ dễ hiểu: lượng tử hóa giống nén cả thư viện lớn vào một thẻ nhớ tốc độ cao, bỏ bản trùng và bụi dữ liệu, giữ lại các cuốn sách thật sự cần thiết.

Trong các bài toán bám giáo trình, SLM tinh chỉnh trên dữ liệu sạch thường đạt tỉ lệ tín hiệu trên nhiễu tốt hơn mô hình cloud tổng quát.

Điểm Nghẽn: Luật 134/2025 Và Bẫy Trách Nhiệm Cloud

Tại Việt Nam, Luật số 134/2025/QH15 đặt AI giáo dục vào nhóm rủi ro cao. Điều này thay đổi luật chơi: trường học không thể chỉ dựa vào nhà cung cấp, mà phải gánh trách nhiệm triển khai.

Các rủi ro chính khi dùng cloud AI trong giáo dục:

- Rủi ro chủ quyền dữ liệu: dữ liệu học sinh ra ngoài hệ thống nội bộ trở thành điểm nhạy tuân thủ.

- Rủi ro đánh giá phù hợp: hệ thống không đạt chuẩn có thể bị đình chỉ hoặc thu hồi.

- Rủi ro đầu ra: đơn vị vận hành phải chịu trách nhiệm với nội dung sai lệch do AI tạo ra.

SLM cục bộ giải quyết xung đột này ở tầng kiến trúc: dữ liệu và suy luận ở lại trên thiết bị, không cần outbound mặc định cho các vòng học tập thông thường.

Phần Cứng 2026: Vì Sao NPU Chiến Thắng

NPU đã trở thành trái tim tính toán AI học đường.

Nếu trước đây ta so đồng hồ CPU, nay giáo dục AI đo theo thông lượng trên watt và độ trễ phản hồi ban đầu.

NPU quan trọng vì:

- Prefill nhanh: nạp ngữ cảnh lớn trong thời gian rất ngắn.

- Hiệu quả năng lượng: thường cao hơn CPU từ 10-40 lần trong suy luận AI.

- Giữ flow: phản hồi cục bộ có thể đủ thấp để không làm đứt mạch tư duy.

Về sư phạm, phản hồi chậm làm hỏng vòng chú ý và làm yếu productive struggle.

Tổng Hòa: AI Là Bộ Phận Giả Nhận Thức, Giáo Viên Là Người Điều Phối

Quan điểm Locuno không chống AI. Quan điểm Locuno chống tư duy máy bán đáp án.

Khi AI bị dùng như máy bán hàng, nó triệt tiêu nỗ lực học tập hiệu quả. Khi AI được dùng như bộ phận giả nhận thức, nó gánh việc lặp và trả lại băng thông chiến lược cho giáo viên.

Phân công vai trò mới:

- Giải phóng hành chính: soạn quiz, chấm mức cơ bản, phản hồi thủ tục.

- Điều phối con người: nhận diện nản lòng, sửa ngộ nhận, dẫn dắt tư duy bậc cao.

- Gợi mở Socratic: AI chỉ đưa gợi ý hoặc câu hỏi phản biện trước khi tiến tới đáp án.

Các nghiên cứu về công cụ phản hồi tự động cho thấy thời lượng giáo viên độc thoại có thể giảm, mở thêm không gian cho đối thoại do học sinh dẫn dắt.

Green AI: Học Trên Mỗi Watt

Bền vững trong 2026 là hạ tầng sư phạm, không phải khẩu hiệu.

Suy luận tại biên có thể tiết kiệm năng lượng rất lớn so với gọi cloud liên tục ở quy mô trường học.

| Chỉ số | Edge SLM trên thiết bị học sinh | Cloud inference |

|---|---|---|

| Công suất điển hình | < 2W cho suy luận cục bộ | 20-200W ở phía cụm máy chủ theo ngữ cảnh gọi |

| Lưu lượng dữ liệu | Tối thiểu hoặc không outbound cho vòng lặp nội bộ | Phụ thuộc mạng và máy chủ bên ngoài |

| Cường độ carbon khi mở rộng | Thấp hơn, phân tán | Cao hơn, tập trung |

Với cơ quan quản lý giáo dục, đây là bài toán ngân sách, độ bền vận hành và tuân thủ, không chỉ ESG.

Case In Point: Thí Điểm Việt Nam 2026

Các mô hình thí điểm của MoET đang cho thấy hướng dịch từ tiêu dùng AI tổng quát sang thiết kế năng lực AI có chủ đích.

Khung 4 trụ cột vận hành thực tiễn:

- Tư duy lấy con người làm trung tâm.

- Đạo đức và pháp luật AI.

- Kỹ thuật ứng dụng với SLM cục bộ.

- Thiết kế hệ thống, gồm mini-tutor theo ngữ cảnh.

Trong triển khai tốt, học sinh không dùng AI để rút đáp án cuối. Các em dùng mô hình cục bộ theo đối thoại Socratic, nơi phải nêu được nguyên lý trước khi nhận gợi ý.

Tầm Nhìn: Từ Người Dùng Sang Kiến Trúc Sư Trí Tuệ

Chiến lược đã rõ: rời cloud wrapper để đầu tư hạ tầng trí tuệ.

Ưu tiên cho nhà quản lý giáo dục:

- RAG cục bộ bám chương trình học.

- Thiết bị học sinh có NPU đủ mạnh.

- Workflow lấy giáo viên làm trung tâm.

- Ranh giới dữ liệu được thiết kế sẵn theo chuẩn tuân thủ.

Lớp học chủ quyền hiện là mô hình hiếm hoi mở rộng được đồng thời theo ba tiêu chí: hợp pháp, đạo đức, bền vững.

Khuyến Nghị Chiến Lược

| Chỉ số | Mục tiêu | Kết quả sư phạm |

|---|---|---|

| Điện năng tiêu thụ | < 2W mỗi học sinh khi suy luận | Green AI và hạ tầng bền vững |

| Dữ liệu outbound | 0% cho vòng lặp học tập thường quy | Bám sát tuân thủ Luật 134/2025 |

| Độ trễ phản hồi | < 50ms TTFT mục tiêu | Giữ flow cho người học |

| Trọng tâm giáo viên | +10% hấp thụ ý tưởng học sinh | Tăng mentoring lấy con người làm gốc |

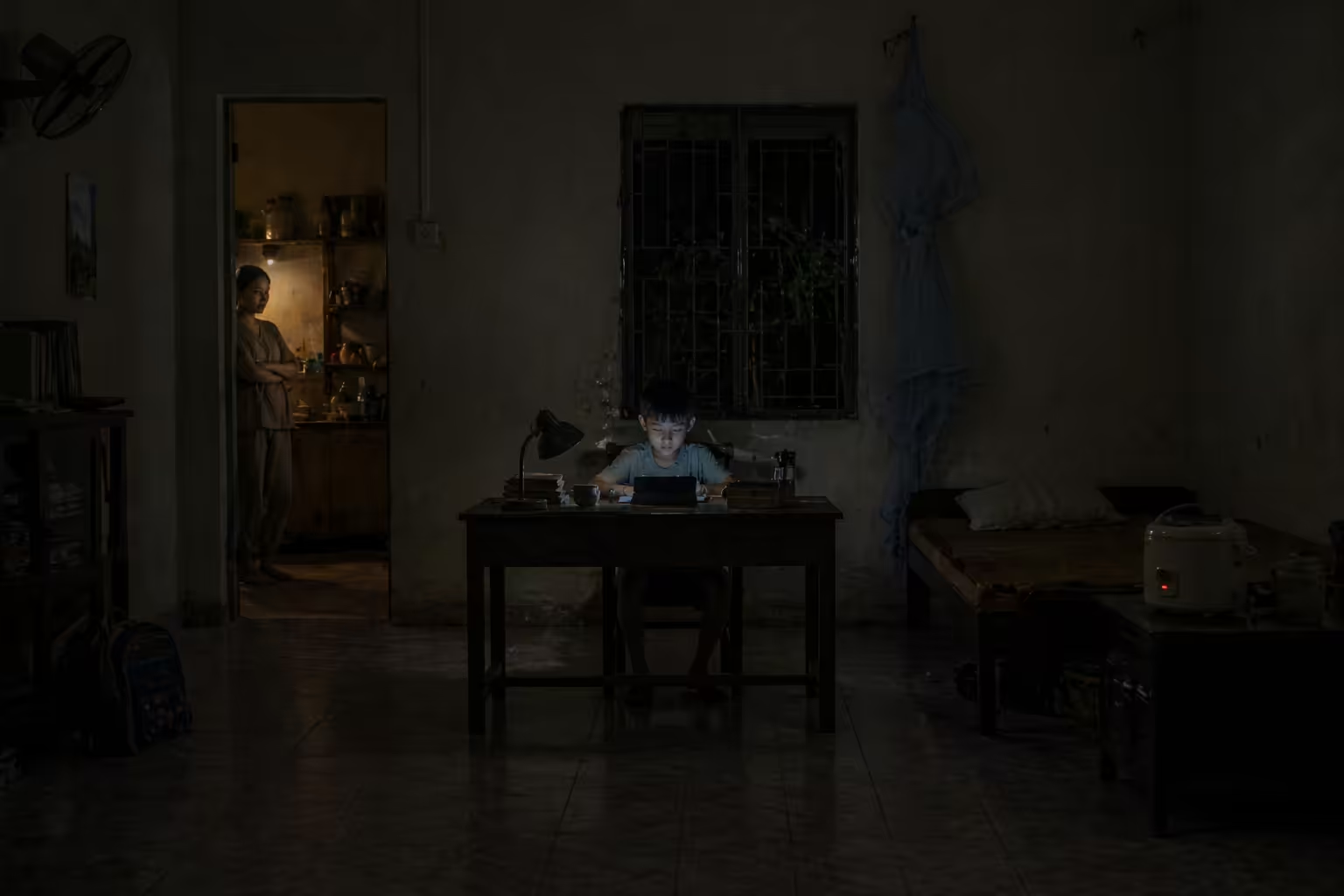

Tương lai trí tuệ giáo dục không nằm ở vài đám mây tập trung. Nó nằm ở hàng triệu điểm sáng phân tán trong từng lớp học. Trong nhiều bối cảnh, mô hình nhỏ nhất có thể là người thầy hữu ích nhất.

Ngày đăng: 24 Th04, 2026 · Cập nhật: 5 Th05, 2026