Kiến trúc hậu LLM: Sự trỗi dậy của Neural-Symbolic AI

Cuộc cách mạng AI tạo sinh đang chạm tới một nghịch lý tréo ngoe. Sau những màn trình diễn gây choáng ngợp, các mô hình ngôn ngữ lớn bắt đầu bộc lộ sự đuối sức về mặt niềm tin.

Dữ liệu thực tế từ các môi trường không kiểm soát cho thấy sai số có thể dao động từ 20 đến 50 phần trăm. Trong các lĩnh vực nhạy cảm như y tế, luật pháp hay tài chính, một câu trả lời ảo giác không chỉ là lỗi phần mềm, mà có thể kéo theo tổn thất tài chính lớn, rủi ro pháp lý, hoặc hậu quả an toàn nghiêm trọng. Không ngạc nhiên khi tỷ lệ hoài nghi với đầu ra AI vẫn ở mức cao trong cộng đồng người dùng và giới quản trị [1].

Vấn đề cốt lõi là kiến trúc. LLM hiện tại về bản chất là cỗ máy dự đoán token tiếp theo theo xác suất thống kê, chứ không phải hệ thống có mô hình nội tại về sự thật hay logic hình thức. Chúng rất giỏi tạo câu trả lời nghe hợp lý, nhưng không mặc định biết điều đó có đúng hay không.

Vì vậy, chỉ tăng kích thước mô hình hoặc nạp thêm dữ liệu là không đủ. Hướng đi hậu LLM đang dần rõ ràng: ghép khả năng học mẫu của mạng thần kinh với khả năng suy luận và kiểm chứng của logic ký hiệu. Mục tiêu là xây AI biết giải thích quyết định, kiểm tra nhất quán, và quan trọng nhất là biết nói “Tôi không biết” khi thiếu bằng chứng.

Bóc tách: Học máy vs. Logic

Ở mức nguyên lý, LLM và Symbolic AI đi theo hai triết lý đối lập.

LLM hiện đại tối ưu xác suất của token tiếp theo. Chúng học từ kho dữ liệu khổng lồ để nắm ngữ pháp, ngữ nghĩa gần đúng, và các mẫu diễn đạt. Điểm mạnh là linh hoạt, sáng tạo, xử lý tốt dữ liệu phi cấu trúc. Điểm yếu là thiếu cơ chế tuân thủ quy tắc chặt chẽ theo kiểu nếu-thì.

Symbolic AI thì ngược lại. Mọi khái niệm được biểu diễn thành ký hiệu, luật, ràng buộc hoặc đồ thị tri thức. Suy luận được thực hiện theo luật xác định: nếu không đủ điều kiện, hệ thống trả về không có kết quả thay vì đoán bừa. Điểm mạnh là minh bạch và kiểm toán được. Điểm yếu là khó xử lý dữ liệu mơ hồ, nhiễu, hoặc ngôn ngữ tự nhiên phức tạp.

Neural-Symbolic AI xuất hiện để kết hợp hai phần mạnh nhất này:

- Neural: nhận diện mẫu linh hoạt và học trực tiếp từ dữ liệu thô.

- Symbolic: bảo toàn logic, nhất quán và khả năng truy vết.

Theo nhiều tổng quan gần đây, sự tích hợp này đang tái định hình quỹ đạo AI, đưa hệ thống tiến gần hơn tới kiểu tư duy kép giống con người: nghĩ nhanh bằng trực giác dữ liệu và nghĩ chậm bằng suy luận ràng buộc [1], [2].

Điểm nghẽn: Ảo giác và sự tự tin thái quá

Đây không phải tranh luận học thuật, mà là nguyên nhân trực tiếp của thất bại triển khai hiện nay.

LLM ảo giác vì không có lớp kiểm soát buộc câu trả lời phải hợp lệ theo tri thức hoặc theo luật. Đồng thời, mục tiêu huấn luyện thông thường không thưởng cho việc thừa nhận bất định. Kết quả là mô hình có xu hướng trả lời cho trôi chảy ngay cả khi không chắc chắn.

Hệ quả là một dạng tự tin độc hại: đầu ra nghe thuyết phục nhưng có thể sai ở những điểm quan trọng nhất.

Trong các tác vụ như chẩn đoán y khoa, tư vấn pháp lý, hay điều phối hệ thống tự hành, chúng ta cần dấu vết quyết định có thể kiểm toán. Nếu AI biết mình không biết và biết dừng đúng lúc, rủi ro hệ thống sẽ giảm đáng kể. Đây là giá trị cốt lõi mà lớp suy luận ký hiệu có thể bổ sung [8].

Sự giao thoa: Mô hình Hybrid lấy con người làm trung tâm

Cách tổng hợp thực tế hiện nay đi theo ba họ kiến trúc chính.

1) Neural-first

LLM đi trước để đọc hiểu và đề xuất phương án. Sau đó công cụ ký hiệu kiểm chứng từng bước.

Ví dụ nổi bật là AlphaGeometry: mô hình transformer sinh các bước dựng hình, còn bộ máy suy diễn hình học cổ điển xác thực theo định lý. Cấu trúc nhanh-rồi-chậm này giúp hệ thống đạt hiệu suất rất cao trên bài toán hình học cấp Olympic [6].

2) Symbolic-first

Hệ thống bắt đầu bằng luật và ràng buộc cứng. LLM chỉ làm nhiệm vụ chuyển dữ liệu phi cấu trúc về dạng có thể kiểm chứng.

Một tình huống gần thực tế là kiểm tra hợp đồng tại tổ chức tài chính: luật nội bộ và quy định pháp lý là khung cố định, còn LLM trích xuất điều khoản từ văn bản tự nhiên để đối chiếu vào khung đó.

3) Tight hybrid

Neural và symbolic được tích hợp sâu ngay trong huấn luyện hoặc giải mã. Có thể là regularization theo logic, mạng suy luận khả vi, hoặc sinh đầu ra theo grammar ràng buộc.

Trong ứng dụng y tế, các hệ thống lai kết hợp LLM với luật chuyên gia đã cho thấy độ chính xác cao hơn và quan trọng hơn là có chuỗi suy luận kiểm toán được, thay vì kết luận hộp đen [5].

Góc nhìn phản biện: Cái giá của sự chính xác

Hệ thống lai không phải viên đạn bạc. Chúng tạo ra những chi phí mới cần chấp nhận.

- Kỹ nghệ tri thức: xây và bảo trì bộ luật tốn thời gian chuyên gia.

- Grounding ký hiệu: ánh xạ từ ngôn ngữ tự nhiên sang biểu diễn hình thức vẫn khó.

- Độ trễ: thêm vòng kiểm chứng logic đồng nghĩa tăng latency.

- Nhân sự: cần đội ngũ lai giữa ML và tư duy logic hình thức.

Đổi lại, hệ thống có các lợi ích nền tảng:

- Truy vết và giải trình tốt hơn.

- Độ tin cậy cao hơn trong miền có quy tắc.

- Khả năng xử lý bất định trung thực hơn.

Trong các miền đòi hỏi kiểm toán, chỉ cần cải thiện nhỏ về độ đúng nhưng lớn về khả năng giải thích cũng đã rất có giá trị.

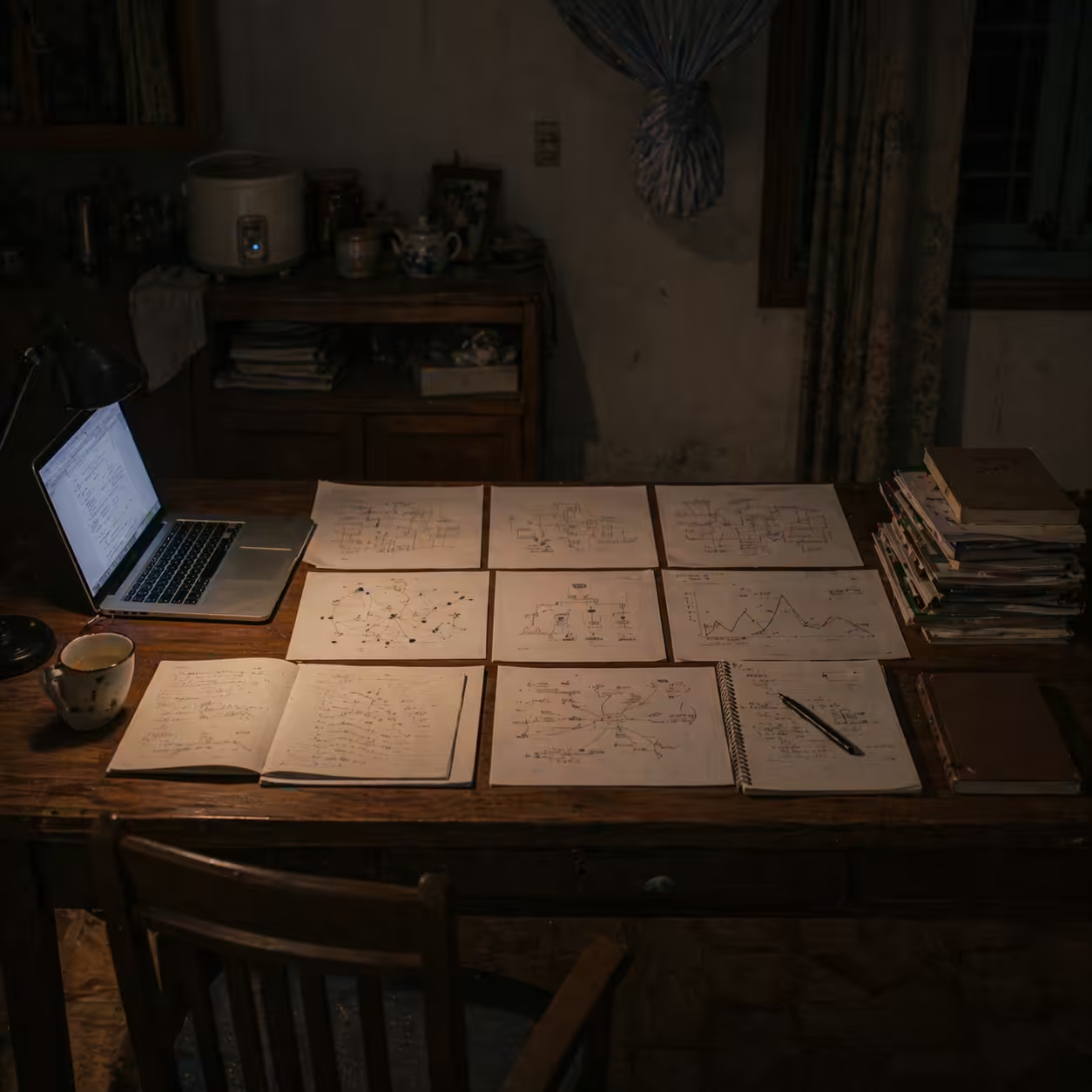

Lời kết: Tầm nhìn Locuno

Chúng ta đang ở ngã rẽ của kiến trúc AI. Kỷ nguyên phun dữ liệu vào mô hình lớn và kỳ vọng mọi thứ tự đúng đang dần khép lại. Chương tiếp theo sẽ thuộc về các hệ thống vừa mạnh vừa có trách nhiệm.

Tại Locuno, AI nên khuếch đại trực giác con người chứ không thay thế con người. Neural-Symbolic mời con người vào vòng lặp: chỉnh tri thức, hiệu chỉnh suy luận, và ra quyết định ở các điểm bất định.

Đó không phải lỗi của công nghệ. Đó là một tính năng cốt lõi của tương lai AI lấy con người làm trung tâm.

Tham khảo

- [1] Nawaz, U. et al. (2025).

- [2] Samuel, A. (2025).

- [5] Prenosil, G. A. et al. (2025).

- [6] Trinh, T. H. et al., Nature (2024).

- [8] Tổng quan công nghiệp về neurosymbolic và giảm hallucination.

Ngày đăng: 23 Th04, 2026 · Cập nhật: 5 Th05, 2026

Bài viết liên quan

Giao thức Thấu cảm Kỹ thuật: Kiến trúc của sự kết nối nhân văn trong kỷ nguyên tự động hóa

Kiến trúc của sự Tự trị Số: Giải mã Chủ quyền trong Thời đại Chủ nghĩa Tư bản Giám sát